Tabla de contenidos

La semana del 21 de octubre Google anunció que se lanzaba una nueva actualización del algoritmo llamada BERT. Esta actualización representa uno de los mayores avances en la historia de los buscadores y el mayor avance de los últimos cinco años.

¿Qué es Google BERT?

Las siglas BERT significan representación de codificador bidireccional de transformadores (Bidirectional Encoder Representations from Transformers).

Se trata de una técnica basada en redes neuronales para el pre-entrenamiento del procesamiento del lenguaje natural (NLP). Los modelos BERT pueden interpretar el contexto completo de una palabra analizando las palabras que vienen antes y después, lo que resulta muy útil para comprender la intención de búsqueda que tiene el usuario al realizar la consulta. Actualmente se procesan las palabras de la búsqueda de manera lineal, una detrás de otra, poniendo el foco en cada uno de los términos sin tener en cuenta el contexto.

Pandu Nayac (Google Fellow and Vice President, Search) afirma que para abordar este cambio se ha tenido que ampliar el hardware tradicional, utilizando los últimos TPU en la nube para construir los modelos BERT y obtener la información más relevante lo más rápido posible.

¿Por qué es útil Google BERT?

El 15% de las búsquedas diarias que se realizan en Google son nuevas, no existe información previa de si los resultados mostrados coinciden con la intención de búsqueda del usuario. Algunas veces los usuarios no saben exactamente las palabras que tienen que utilizar para buscar lo que les interesa, buscan aprender y no saben cómo empezar.

Por este motivo, BERT trata de comprender el lenguaje humano, descubrir lo que está buscando el usuario y mostrarle información que le resulte útil. En especial para búsquedas en las que las preposiciones «a», «de», «para» o la negación «no» son importantes para el significado.

¿Dónde veremos su impacto?

En los resultados de búsquedas y en los fragmentos destacados.

Barry Schwartz afirmaba el pasado día 25 de octubre que debido a esta actualización se habían visto afectadas el 10% de las consultas en inglés en Estados Unidos. Con el tiempo se ampliará a más idiomas y países, aunque todavía no está confirmado cuándo podría llegar a España.

Con respecto a los fragmentos destacados, afirma Pandu Nayac que ya se está utilizando un modelo BERT para mejorarlos en 24 países. Se están viendo mejoras significativas en los idiomas coreano, hindi y portugués.

Ejemplos de resultados de búsqueda con Google BERT

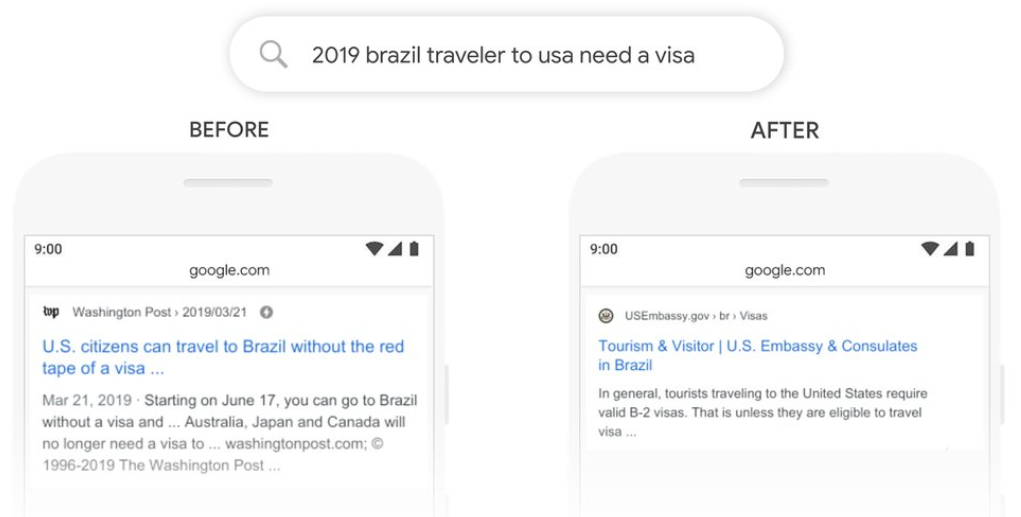

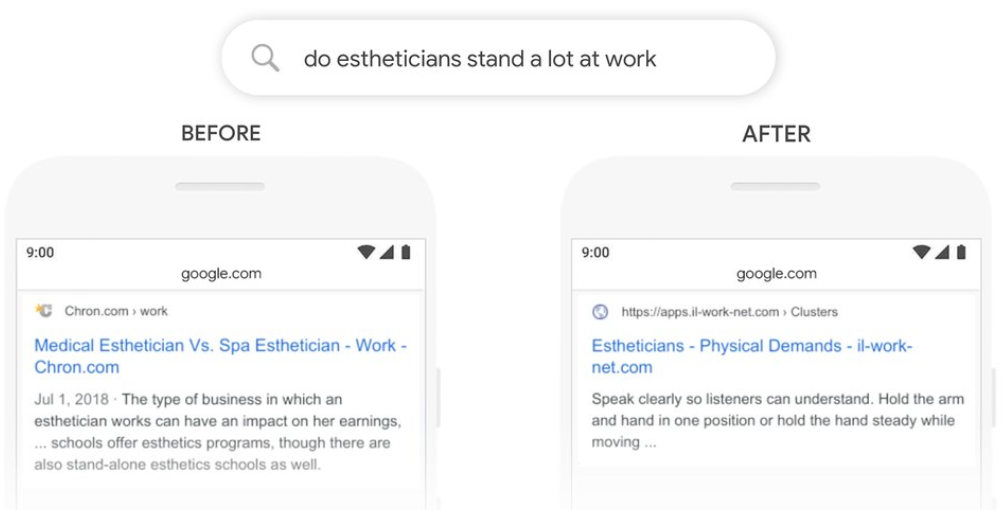

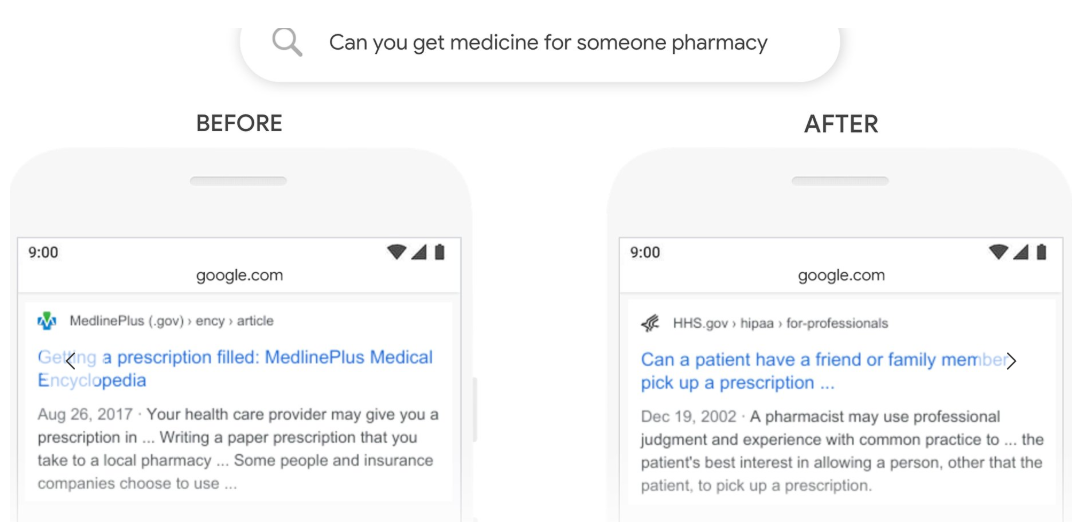

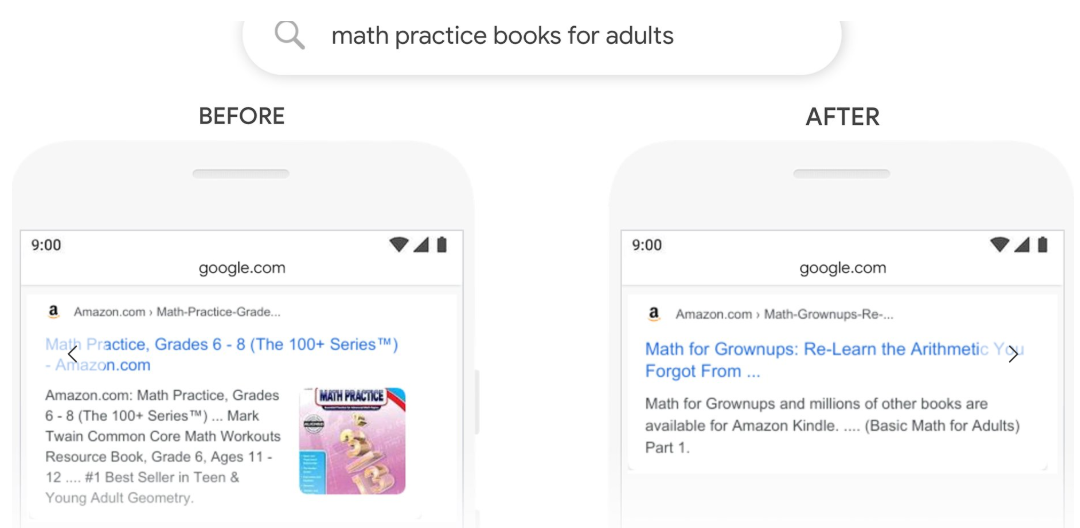

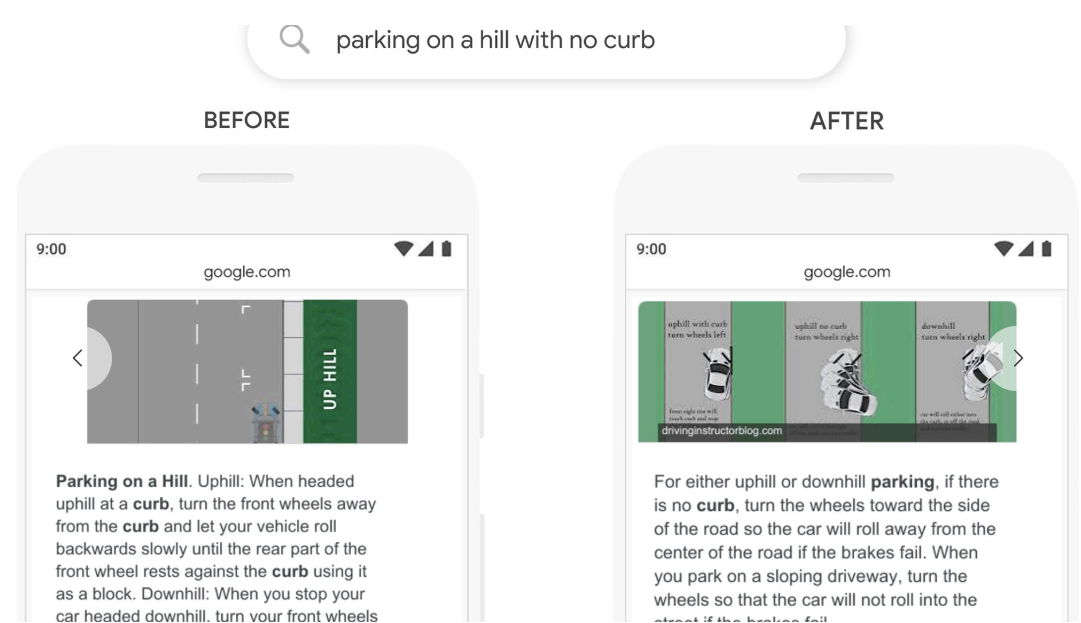

Para entender mejor la aplicación real de esta actualización, desde Google nos ofrecen ejemplos de resultados de búsqueda para ciertas consultas antes y después de la aplicación de Google BERT.

La búsqueda «2019 Brazil traveler to usa need a visa», trata de un brasileño que viaja a Estados Unidos. Anteriormente, Google no era capaz de entender la importancia de la preposición «to» y mostraba resultados sobre ciudadanos estadounidenses que viajaban a Brasil. Con BERT sí se ofrecen resultados relevantes para la búsqueda.

Para la búsqueda «do estheticians stand a lot at work», hasta ahora el sistema de palabras clave o coincidentes mostraba resultados con el término «stand-alone» para búsquedas con el término «stand», aunque no es el significado correcto del término según el contexto de esta consulta. Google BERT entiende que «stand» está relacionado con la demanda de un trabajo.

La búsqueda «can you get medicine for someone pharmacy» con BERT se entiende la importancia de «for someone» y muestra resultados relevantes.

Otro ejemplo es la búsqueda «math practice book for adults». Anteriormente se devolvía como resultado optimo una página de Amazon para comprar un libro de matemáticas incluido en la categoría «young adult». BERT puede entender el contexto del término «adult» y devolver un resultado más útil al usuario.

Ejemplo de fragmento destacado con Google BERT

Para la búsqueda «parking on a hill with no curb» hasta ahora se tomaba como término relevante «curb» y se ignoraba la palabra «no». Google BERT hace foco en el contexto y muestra resultados útiles para esta búsqueda.

¿Qué podemos hacer para optimizar nuestro sitio para Google BERT?

En realidad no podemos hacer nada nuevo, solo seguir redactando los contenidos de nuestro sitio web para los usuarios. Son los investigadores de Google los que están haciendo el trabajo duro para que las máquinas entiendan cada vez más el lenguaje humano con el objetivo de devolver el resultado más relevante para cada una de las búsquedas.

¿En qué lugar quedan las keywords?

De un tiempo a esta parte ya veíamos que para una keyword concreta se posicionaban páginas que ni siquiera la incluían en el contenido de la página ni en áreas prominentes como el title o metadescription. Esto no quiere decir que ya no se tengan en cuenta las palabras clave que utilizan los usuarios en las búsquedas, sino que debemos hacer énfasis en que nuestra página de aterrizaje sea útil para el contexto de esas búsquedas.

Referencias:

- https://searchengineland.com/welcome-bert-google-artificial-intelligence-for-understanding-search-queries-323976.

- https://www.blog.google/products/search/search-language-understanding-bert/.

- https://medium.com/@lola.com/nlp-vs-nlu-whats-the-difference-d91c06780992.